AI生成系のパッケージ管理ランチャーソフトの「Stability Matrix」にて、新規ComfyUIインストール後、高速生成可能なモデルが使えるようになる「Nunchaku」1.2.1を導入してみました。生成まで確認。RTX5000番台、Blackwellシリーズ対象。

OSはWindows 10 / 11(64bit)環境かつ、NVIDIA GPU搭載パソコンを前提とした記事です。Blackwell環境では、Nunchakuを入れると超高速の恩恵が得られる!らしいということで導入。ComfyUIでのNunchaku推奨バージョンは1.0.0だけど、あえてz-imageではさらに高速化が見込めるという1.2.1を導入してみました。(ComfyUI-nunchaku 1.2.1 + nunchaku 1.2.1)

1日試行錯誤してなんとか導入。qwenは画像生成まで確認。z-imageはまだです。生成できるようになるまで記事を更新予定。その手順紹介となります。まったく同じようにやっても動く保証はないけど、参考にしてみてね。

「Stability Matrix」とは?

Stable Diffusion 系UI(ReForge / ComfyUI など)をまとめて管理・起動できるランチャー。RTX5000シリーズを使っている人でも、容易に起動できるStable Diffusion(ReForgeやComfyUI)環境が作れます。

「Stability Matrix」のダウンロードはこちら(https://github.com/LykosAI/StabilityMatrix/releases)

Assist下にある「StabilityMatrix-win-x64.zip」を選び、ダウンロード。解凍後に「StabilityMatrix.exe」を実行します。

前提環境

前提:Stability Matrix(v2.15.6以降)、Windows/NVIDIA環境。

対象:GPUのRTX5000シリーズ、RTXPRO Blackwell以降(RTXPRO4000、4500、5000、6000)を使っている。

ヌンチャク「Nunchaku」(SVDQuant量子化)は導入環境がシビアで、少しのバージョン違いでも動作しないことが多く、構築済みの既存環境への導入は非推奨です。導入手順次第で依存関係環境も簡単に壊れるので、「Stability Matrix」にて新規ComfyUI環境を作った上で導入してください。

ComfyUI導入+Nunchakuインストール

以下の手順で進めていきます。

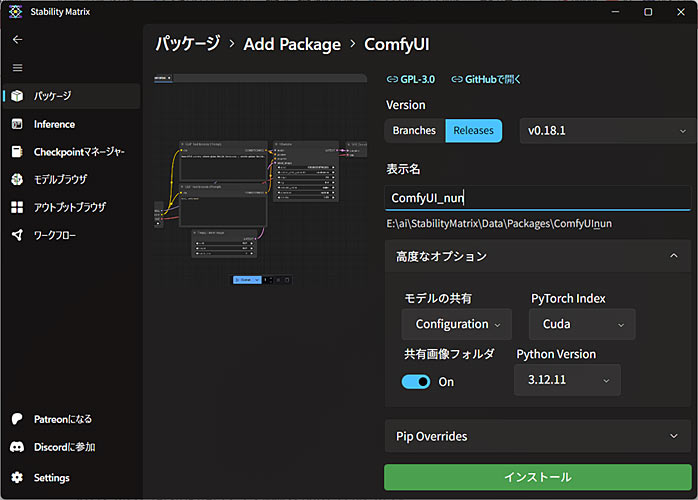

新規ComfyUI環境作成(新規環境インストール 3.12.11)

今回は、ComfyUIバージョン0.18.1使用。(0.18.2以降と互換あり)

高度なオプションにて、Pytorch index:cuda 、Pytorch version:3.12.11

を指定してインストール。

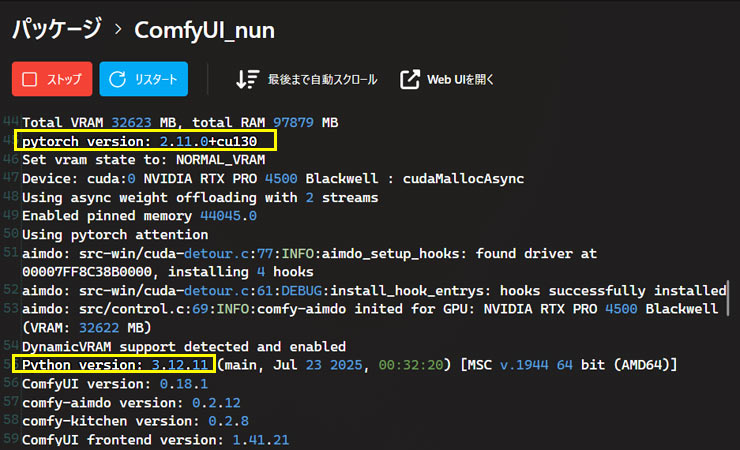

環境を確認する

先ほどインストールした新規ComfyUIを(launch)起動します。ComfyUIバージョン0.18.x以降を使用の場合は、追加のComfyUI-managerのインストールは省略できます。(ComfyUIバージョン0.18x以前の場合は、パズルアイコンextensionを選んで、ComfyUI-managerをインストールする必要あり)

コンソール画面内の「Python Version」を確認します。

私の環境では「pytorch version: 2.11.0+cu130、Python version: 3.12.11」。

安定版 cu128 を指定して入れ直す

上記ステップ2での画面では、cu130が導入されていましたが、今回必要なのは「cu128」。

cu128以外の場合には、必要なモジュールをcu128版に入れ替える必要があります。

一度、コンソール画面で「ストップ」を押して、comfyuiを終了させてください。

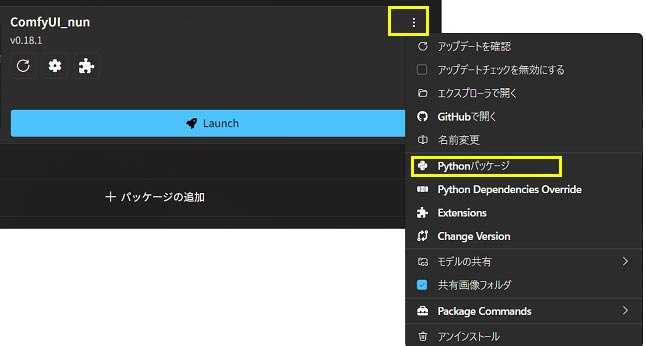

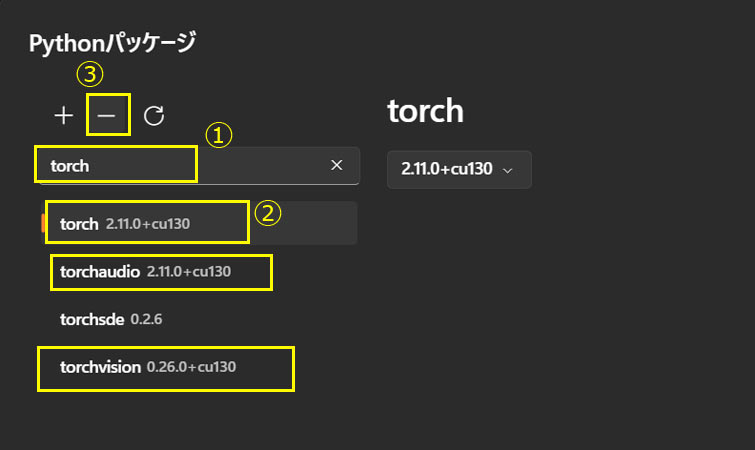

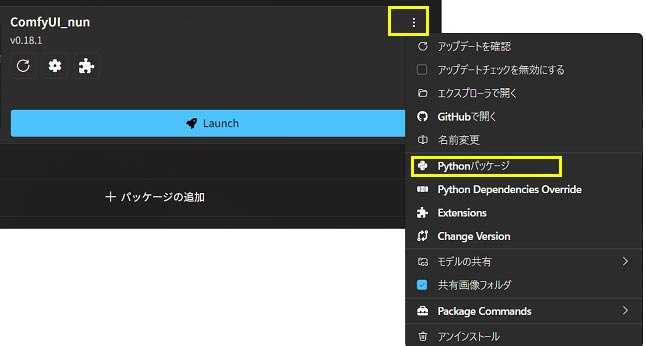

Stability Matrixのcomfyui起動前画面の「…」から「pytorchパッケージ」を選ぶ。

検索欄に「torch」をいれて、

「torch」「torchvision」「torchaudio」をそれぞれ名前リストから選び、「-」ボタンから、3つアンインストール(削除)を行います。削除するものは完全一致名のものだけです。+cu130と表示があります。

コマンド上なら仮想環境にて

pip uninstall -y torch torchvision torchaudio

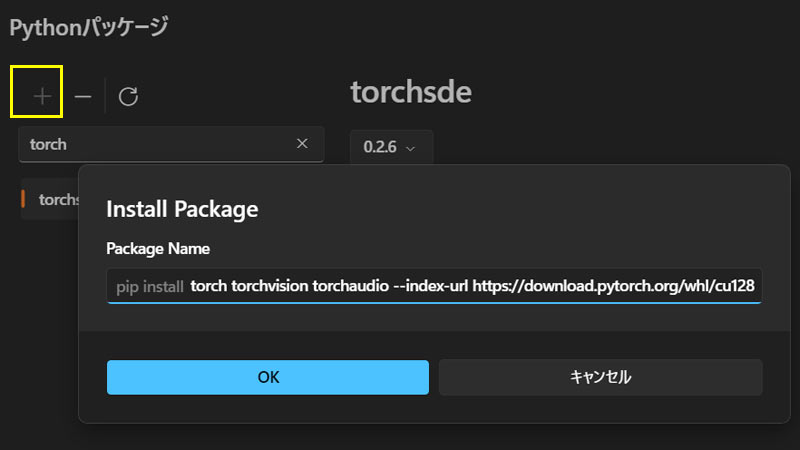

次にCUDA 12.8版を再インストールします。今度は「+」ボタンを押して、Install packageから以下のコマンドをpip install 以降をコピペしてください。

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu128

ダウンロード&インストール等に少々時間を要します。

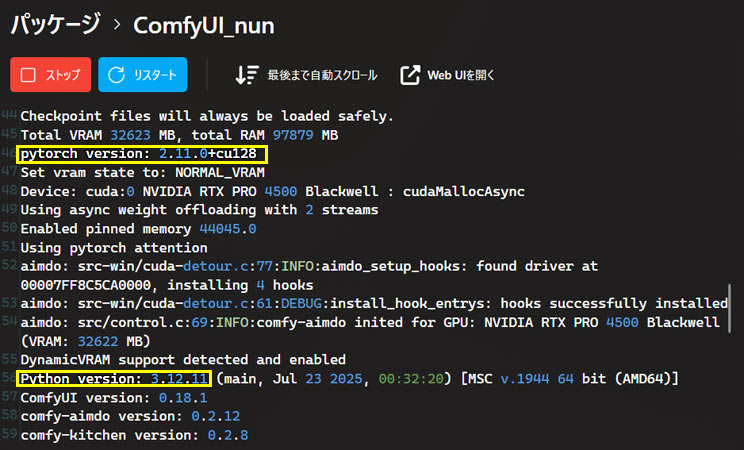

環境確認(無事導入されたか)

再度、ComfyUIを(launch)起動します。

無事成功していれば、

「pytorch version: 2.11.0+cu128、Python version: 3.12.11」の表示となっています。

コンソール画面上の「ストップ」を押して、一度ComfyUIを終了させます。

ComfyUI-nunchaku 1.2.1 系を入れる。

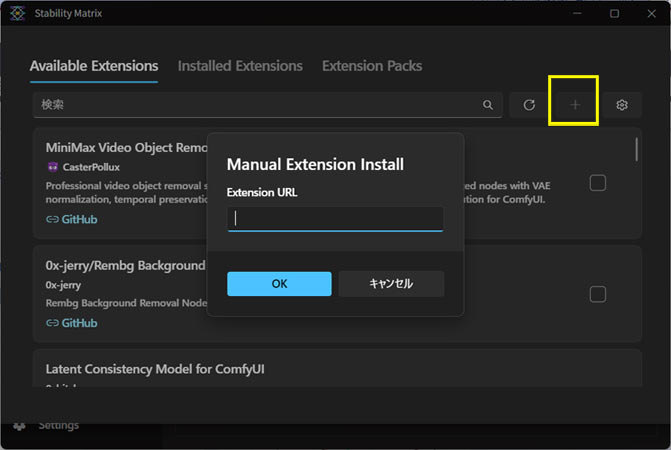

ComfyUI-manager(ComfyUIの機能拡張)上からでは、推奨されるComfyUI-nunchaku(初期バージョン)がインストールされてしまうので、Stability Matrixの「Manual Install」を使い、直接comfyUI-nunchaku の公式 GitHub リポジトリ(URL)から導入します。

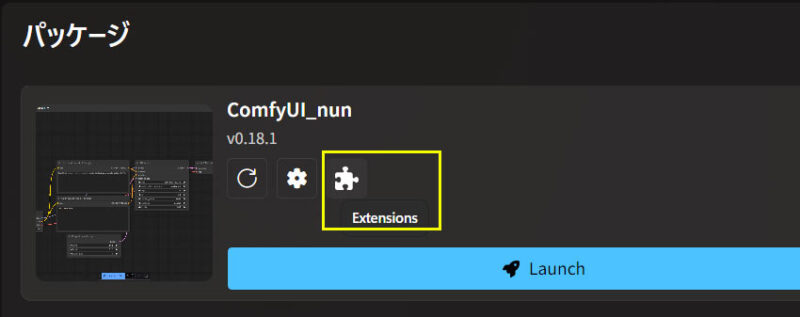

Stability Matrixのcomfyui起動前画面のパズルアイコン(extensions)を起動し、「+」ボタンを選ぶ。

Stability Matrixの「Manual Install」に以下の、comfyUI-nunchaku の公式 GitHub リポジトリ(URL)を入力。

https://github.com/nunchaku-ai/ComfyUI-nunchaku上記だけだと、依存関係ファイルが不足しているので、続けて不足モジュールをインストール追加します。

Stability Matrixのcomfyui起動前画面の「…」から「pytorchパッケージ」を選ぶ。

次に不足しているファイルをまとめてインストールします。今度は「+」ボタンを押して、Install packageから以下のコマンドをpip install 以降をコピペしてください。

pip install -U accelerate==1.9.0 peft==0.17.0 diffusers==0.36.0 protobuf==4.25.8 transformers==4.55.2 huggingface-hub==0.34.0 protobuf==4.25.8

accelerate==1.9.0

peft==0.17.0

diffusers==0.36.0

protobuf==4.25.8

transformers==4.55.2

huggingface-hub==0.34.0

protobuf==4.25.8

に合わせます。

「閉じる」を押す。

comfyUIにnunchakuヌンチャク本体を導入

この時点では、まだNunchaku本体を導入していません。comfyUIを起動しても「Nunchaku version: Package ‘nunchaku’ not found.」と表示されます。

ここからNunchaku本体を導入しますが1つ注意点があって、公式手順の1つであるcomfyui上のmanagerからはcomfyui-Nunchakuのインストールは行わないでください。常に未インストール扱い表示になっていますが、comfyui-Nunchakuインストールを行うと依存関係が壊れてしまい、dllモジュールが見つからない等エラーが発生し、comfyuiがまともに起動できなくなりました。

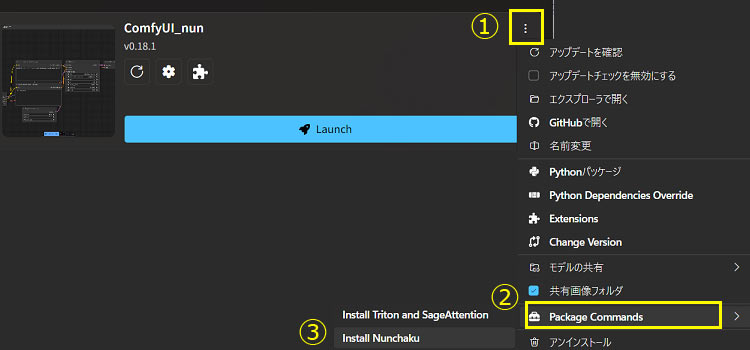

Stability Matrixのcomfyui起動前画面の「…」から「package commands」から「Install Nunchaku」を選んで自動インストールできます。事前準備が済んでいるので、(2026年3月26日時点では)すんなりとインストールできました。

comfyUIのnunchakuアップデートで最小モード(制限モード)解除

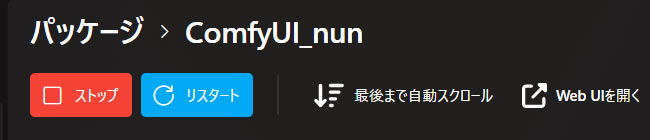

再度、Stability Matrixの該当comfyuiを起動します。

コンソール画面にて、

「’nunchaku_versions.json’ not found. Node will start in minimal mode. Use ‘update node’ to fetch versions.」と表示され、一部のnunchakuファイルが不足しているため、最小モードで起動と表示が出ます。

このモードを解消していきます。

ほかに、cu130ではないため「WARNING: You need pytorch with cu130 or higher to use optimized CUDA operations.」と表示されますが、無視して大丈夫です。

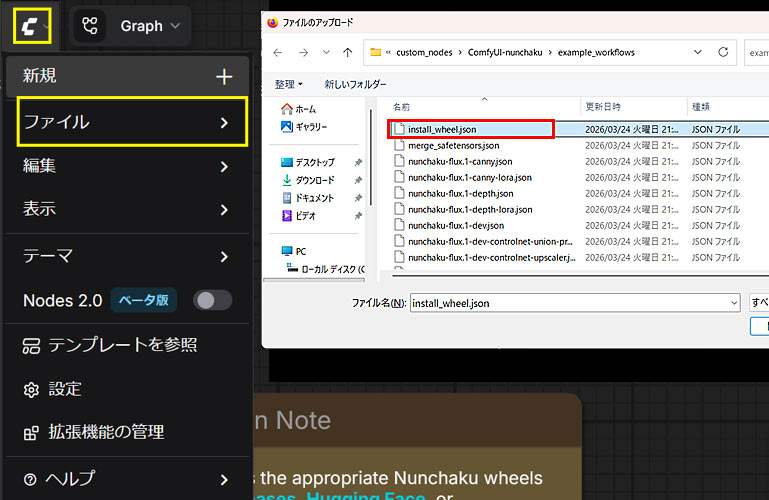

WebUIを開くを押して、ブラウザでComfyUI画面を開く。

ComfyUI画面のメニューから、ファイル>「開く」を選び、

StabilityMatrixがインストールされているフォルダ内「\Data\Packages\」内にある

今回構築したComfyUI名\custom_nodes\ComfyUI-nunchaku\example_workflows フォルダを開きます。「install_wheel.json」を選んで、WORKFLOWを読み込みます。

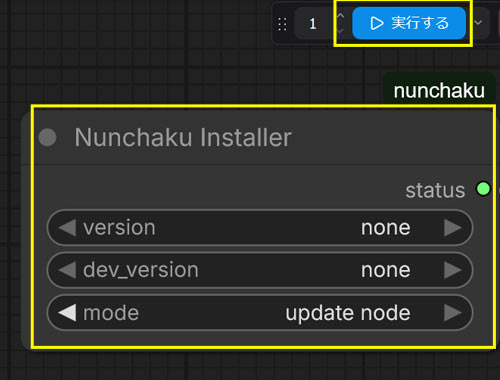

「Nunchaku Installer」ノードの

「mode」を「update node」へ変更。ほかの項目は「none」に設定し「実行」する。必要なファイルがダウンロードされます。

コンソール画面に「Successfully created/updated ‘nunchaku_versions.json’ from CDN.」と出れば成功です。

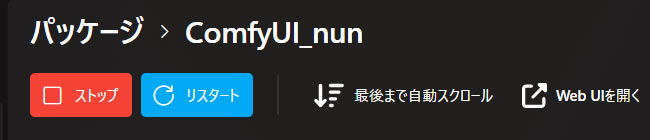

次に、コンソール画面の「ストップ」を押した後、「StabilityMatrix」を終了させてください。ブラウザ上のcomfyUI画面も閉じます。これでNunchakuの最小モード(制限モード)が解除されます。

使用するモデルを選ぶ。

使用GPUによって、使用するモデルタイプが異なります。

RTXPROBlackwellシリーズ及び、RTX5000系は FP4。

Blackwell 以外の旧世代(RTX 5000 Ada含む)は INT4を選んでください。

WORKFLOW(サンプル)は、

自分のcustom_nodes\ComfyUI-nunchaku\example_workflows フォルダに標準ワークフローテンプレあり。付属WORKFLOWを使って画像生成まで確認済です。別途追加のモデルは必要です。

| モデル一覧 | nunchaku版 | workflows(サンプル)・備考 |

|---|---|---|

| Qwen 2512 | 公式該当なし 非公式「QuantFunc氏公開版」 | 4-stepLoRA融合済みモデル。 速度重視は r32を選ぶ。 ワークフローは配布サイトにあり。 Text Encoder:qwen_2.5_vl_7b_fp8_scaled.safetensors VAE:qwen_image_vae.safetensors LORA:なし bestquality:1回目11秒。2回目6秒。 |

| Qwen-Image-EDIT-2511 | 公式該当なし 非公式「QuantFunc氏公開版」 fp4:11.9GB~ | 4-stepLoRA融合済みモデル。速度重視は r32。 ワークフローは配布サイトにあり。 Text Encoder:qwen_2.5_vl_7b_fp8_scaled.safetensors VAE:qwen_image_vae.safetensors LORA:なし bestquality:1回目28秒。2回目15秒(1024x1024) |

| qwen-image | 公式「nunchaku-ai」 nunchaku-qwen-image | 標準テンプレ(cfg1、1328x1328) r128-8stepで22秒、2回目10秒。 r32-4stepで7秒、2回目6秒。 プロンプトを効かせたいなら128-8step推奨。 黒画面になる場合は、Sageattentionを無効にする。 |

| z-image-turbo | 公式「nunchaku-ai」 nunchaku-z-image-turbo | 標準テンプレ(cfg1、1328x1328) 起動オプション–fastでエラー。 nunchaku標準のZ-Image loader(zimage.py)が エラーで動かない。 原因は「ussoewwin氏v2.4.3ComfyUI-QwenImageLoraLoader」で解説されていました。 回避策は別記事に書こうと思います。 |

| flux1 | 公式「nunchaku-ai」 nunchaku-flux.1-kontext-dev (canny問題なし) | 標準テンプレ(cfg1、step20) 配置済のloaderではエラーとなるので、 同名loaderを再配置することで生成確認。 |

| FLUX.2-klein | 現在なし |

追加の別途モデル

・?

競合有無ノード情報

ComfyUI-Florence2 (競合NG)transformers>=4.39.0

comfyui_essentials(DisplayAnyが認識しない)

comfyui-kjnodes(OK)、ComfyUI-QwenImageLoraLoader(OK)

ComfyUI-DistorchMemoryManager(OK)、comfyui-qwenmultiangle(OK)

vnccs-utils(OK)

参考にされる場合は、あくまでも自己責任でご判断ください。